Ich muss ehrlich sein: Als ich anfing, Kling 3.0 Motion Control zu testen, dachte ich, „Bewegungsübertragung“ würde alles auf magische Weise reparieren.

Das war nicht der Fall.

Meine ersten paar Generationen sahen für eine Sekunde aufregend aus, dann fielen sie auseinander. Kameradrift. Charakter wackelt. Seltsame Timing-Sprünge. Die Ausgabe sah aus wie ein vielversprechender Entwurf und nicht wie ein versandfertiger Clip.

Dann habe ich eine Sache geändert: Ich habe aufgehört, Bewegung als visuellen Effekt zu betrachten, und habe begonnen, sie wie ein System zu behandeln.

Dieser Leitfaden ist genau dieses System. Wenn Sie es Schritt für Schritt befolgen, werden Sie mit Kling 3.0 Motion Control eine stabilere, vorhersehbarere und benutzerfreundlichere AI Videoausgabe erzeugen.

Was Kling 3.0 Motion Control tatsächlich bewirkt

Kling 3.0 Motion Control extrahiert Bewegungsmuster aus einem Referenzclip und wendet dieses Muster auf eine neu generierte Szene an.

In einfachen Worten:

- Ihre Eingabeaufforderung steuert, was die Szene ist.

- Ihre Referenz steuert, wie sich die Szene bewegt.

Diese Spaltung ist mächtig. Das bedeutet, dass Sie einen starken Bewegungsentwurf beibehalten und gleichzeitig Identität, Garderobe, Umgebung, Beleuchtung und Kunststil ändern können.

Mein 3-Ebenen-Workflow (der, der endlich funktioniert hat)

Ich führe jetzt jedes Projekt durch drei Ebenen in dieser Reihenfolge:

- Referenzqualität

- Bewegungseinstellungen

- Pünktliche Präzision

Die meisten Leute machen zuerst Schicht 3, weshalb sie Credits verbrennen und trotzdem eine instabile Bewegung bekommen.

Schicht 1: Referenzqualität (am wichtigsten)

Eine saubere Referenz liefert Kling saubere Bewegungsdaten.

Eine unordentliche Referenz liefert Kling unordentliche Bewegungsdaten.

Vor dem Hochladen überprüfe ich vier Dinge:

- Ist das Motiv deutlich sichtbar?

- Ist die Bewegungsrichtung ablesbar?

- Ist das Kameraverhalten konsistent?

- Gibt es abrupte Schnitte im Inneren des Clips?

Wenn die Antwort auf eine Frage „Nein“ lautet, tausche ich die Referenz aus, bevor ich etwas anderes tue.

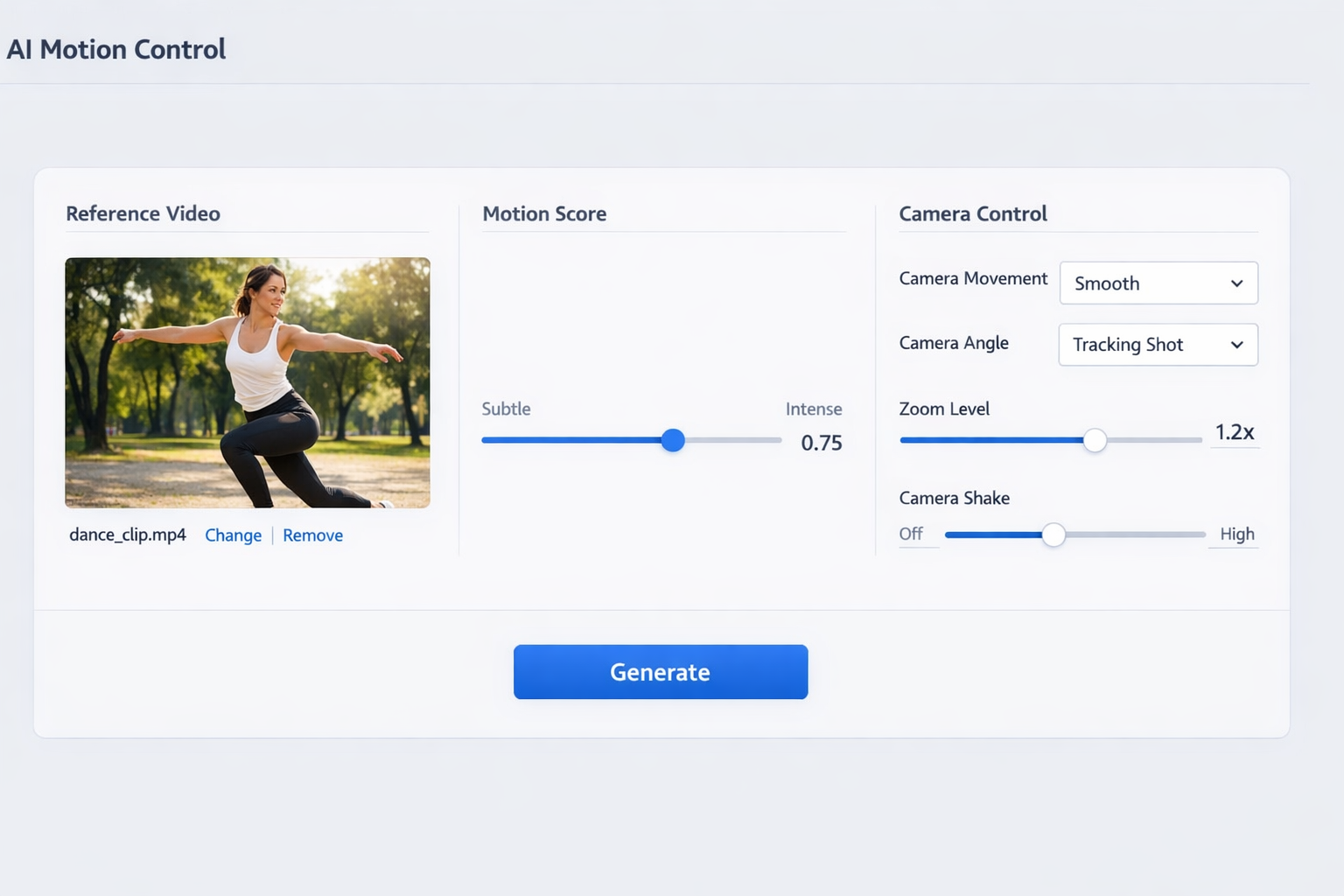

Ebene 2: Bewegungseinstellungen

Das wichtigste Steuerelement ist motion_score.

Ich verwende eine einfache Leiter:

- Niedrig

- Mittel

- Mittelhoch

Ich halte alles andere fest und vergleiche die Ausgabestabilität.

Dies gibt mir einen sicheren Bereich für genau dieses Eingabeaufforderungs- und Referenzpaar.

Schicht 3: Pünktliche Präzision

Ihre Aufforderung ist immer noch sehr wichtig. Ich strukturiere meine so:

- Subjektidentität

- Szenenkontext

- Kameraabsicht

- Qualitätsbeschränkungen

Beispielskelett:

A female street dancer in a futuristic neon alley at night, cinematic lighting, tracking shot with smooth forward movement, high temporal consistency, avoid jitter and body deformation.

Diese eine Zeile übertrifft oft lange, unübersichtliche Eingabeaufforderungen.

Schritt-für-Schritt: Wie ich stabile Ergebnisse erzeuge

Schritt 1: Wählen Sie zuerst die richtige Referenz aus

Wenn Ihr Referenzclip instabil ist, wird Ihre Ausgabe normalerweise die Instabilität erben.

Ich bevorzuge folgende Referenzen:

- 1 klares Thema

- Vorhersehbares Tempo

- Mäßige Bewegung (für Basistests)

- Minimales Kamerachaos

Das ist ein langweiliger Rat, aber er spart Stunden.

Schritt 2: Legen Sie eine Grundlinie fest, bevor Sie „filmisch“ werden

Ich beginne nie mit hoher Bewegung.

Ich laufe zunächst eine ruhige Grundlinie. Warum?Denn die Basisausgabe sagt mir, ob Identität, Anatomie und Rahmung bereits gesund sind.

Wenn die Grundlinie durchbrochen wird, verstärkt eine starke Bewegung das Scheitern.

Schritt 3: motion_score in kontrollierten Deltas einstellen

Ich ändere nur eine Variable pro Lauf.

- Lauf A: niedrig

- Lauf B: mittel

- Lauf C: mittelhoch

Dann überprüfe ich:

- Integrität des Subjekts

- Bewegungskontinuität

- Glätte des Kamerapfads

Ich wähle die höchste Punktzahl, die noch die Integrität bewahrt.

Schritt 4: Kamerasprache in der Eingabeaufforderung sperren

Viele YouTuber vergessen das.

Auch bei Motion Control sollte die Kameraabsicht explizit sein:

slow push-intracking shotlocked framegentle pan right

Ohne Kamerasprache improvisiert das Model manchmal „hilfreich“.

Schritt 5: Negative Einschränkungen hinzufügen

Ich füge kurze Leitplanken hinzu, keine langen Absätze:

- Vermeiden Sie Jitter

- Vermeiden Sie verzogene Gliedmaßen

- Vermeiden Sie plötzliche Zoomsprünge

- Bildflimmern vermeiden

Diese Einschränkungen reduzieren die Ausfallrate bei mittleren und hohen Bewegungseinstellungen.

Schritt 6: Varianten nebeneinander vergleichen

Vertraue deinem Gedächtnis nicht.

Ich behalte Varianten in einem einfachen Blatt mit:

- Referenz-ID

- Prompt-Version

- motion_score

- Kameraeinstellungen

- Bestehen/Nicht bestanden-Notizen

Dadurch wird zufälliges Experimentieren zu einem wiederholbaren Arbeitsablauf.

Die 7 häufigsten Probleme (und wie ich sie behebe)

1) Bewegung sieht zu chaotisch aus

Ursache: Bewertung zu hoch oder verrauschte Referenz

Fix: Zuerst die Punktzahl senken und dann bei Bedarf die Referenz ersetzen

2) Abweichungen von der Subjektidentität

Ursache: Schwache Identitätsaufforderung

Fix: Betreffattribute vor Stildetails verstärken

3) Die Kamera fühlt sich zufällig an

Ursache: Kameraabsicht fehlt

Fix: Direkte Kamerasprache in der Eingabeaufforderung hinzufügen

4) Anatomie bricht bei schnellen Bewegungen

Ursache: hohe Bewegung + geringe Strukturbeschränkungen

Fix: Score reduzieren und Integritätseinschränkungen hinzufügen

5) Die Ausgabe sieht langsam und flach aus

Ursache: Bewertung zu konservativ für den Zielstil

Fix: Punktzahl um einen Schritt erhöhen und erneut testen

6) Die ersten 2 Sekunden großartig, die letzten 2 Sekunden schlecht

Ursache: Nichtübereinstimmung der Referenzstimulation

Fix: Wählen Sie Referenzen mit konsistentem Tempo über die gesamte Dauer

7) Inkonsistente Ergebnisse bei allen Teammitgliedern

Ursache: keine freigegebene Vorlage

Fix: Erstellen Sie wiederverwendbare Voreinstellungen mit dokumentierten Bereichen

Meine Eingabeaufforderungsvorlage für Kling 3.0 Motion Control

Verwenden Sie diese Vorlage als Ausgangspunkt:

[Subject + identity details], [environment + lighting], [camera intent], [movement style], [quality constraints], [negative constraints].

Beispiel:

A confident female dancer in black sportswear, wet neon street at night, smooth tracking shot from front-left angle, dynamic but controlled footwork rhythm, high temporal coherence and stable body proportions, avoid jitter, avoid anatomy distortion, avoid abrupt zoom.

Praktische Anwendungsfälle (wo sich das schnell auszahlt)

UGC und Performance-Anzeigen

Sie können glaubwürdige Körperbewegungen in Markenszenen übertragen und dabei den Kamerarhythmus sauber genug für bezahlte soziale Medien halten.

Visuelle Musikschleifen

Die Bewegungsübertragung trägt dazu bei, in kurzen Schleifen auf den Takt abgestimmte Bewegungsmuster aufrechtzuerhalten.

Shorts zur Produktpräsentation

Für konversionsorientierte Kreative ist eine kontrollierte Kamerabewegung oft wichtiger als ein auffälliger Stil.

Erstellerinhalte in großem MaßstabMit vorlagenbasierten Bewegungseinstellungen können Teams eine konsistente Serienausgabe erstellen.

Meine Qualitätscheckliste vor dem Export

Ich versende niemals einen Clip, es sei denn, er besteht alle drei Kriterien:

- Die Bewegungskontinuität ist stabil

- Die Integrität des Subjekts bleibt erhalten

- Die Kameraabsicht stimmt mit dem Storyboard überein

Wenn einer fehlschlägt, iteriere ich.

Allein diese Checkliste hat meine Nutzleistungsrate dramatisch verbessert.

Wie dies mit Preis- und Stack-Entscheidungen zusammenhängt

Wenn Sie Pläne vergleichen, achten Sie nicht nur auf den monatlichen Preis.

Schauen Sie sich die Kosten pro nutzbarem Clip an.

Ein „billiger“ Plan, der viele Wiederholungsversuche erfordert, kann teurer sein als ein höherer Tarif mit stabiler Leistung.

Ich unterteile dies in Kling 3.0 Preise: Kostenlos vs. Pro vs. API.

Wenn Sie zwischen Plattformen wählen, lesen Sie Kling 3.0 vs. Omni vs. Higgsfield.

Einzelheiten zur Implementierung finden Sie in der Kling 3.0 Dokumentation API Anleitung.

Das Fazit

Kling 3.0 Motion Control ist keine Schaltfläche für „Perfektes Video mit einem Klick“.

Es ist besser als das.

Es ist ein kontrollierbares System. Und sobald man es wie ein System behandelt, wird die Qualität wiederholbar.

Wenn Sie eine stabile Ausgabe wünschen:

- Beginnen Sie mit sauberen Referenzen.

- Stimmen Sie motion_score in kontrollierten Schritten.

- Schreiben Sie die Kameraabsicht explizit.

- Speichern Sie erfolgreiche Einstellungen in wiederverwendbaren Vorlagen.

Wenn man das konsequent macht, fühlt sich Kling 3.0 Motion Control nicht mehr wie Experimente an, sondern eher wie Produktion.

Sind Sie bereit, diesen Workflow selbst zu testen? Öffnen Sie das Kling 3.0 Motion Control-Tool und führen Sie noch heute Ihre erste Drei-Punkte-Rangliste aus.